Pourquoi l'imagerie annotée par drone change la donne en matière de surveillance de la santé du maïs 🌱

L'agriculture connaît une révolution silencieuse. Face à la pression croissante pour augmenter le rendement, réduire le gaspillage des ressources et minimiser l'impact environnemental, les agriculteurs se tournent vers agriculture de précision alimenté par l'IA. Et au cœur de cette transformation ? Imagerie haute résolution par drone—en particulier lorsqu'il est associé à des données annotées avec précision.

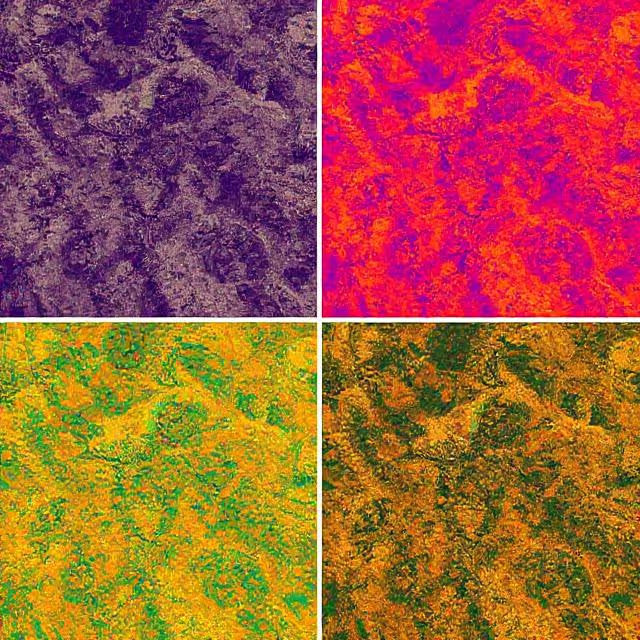

Quand il s'agit de santé des champs de maïs, chaque pixel compte. L'imagerie par drone offre une vue d'ensemble des menaces potentielles (infestation de ravageurs, épidémies, stress hydrique et carences en nutriments), mais c'est annotations qui donnent du sens à ces images. L'étiquetage de sections d'un champ de maïs en fonction de la chlorose, de la densité de la canopée ou des symptômes de maladies transforme les images brutes en informations exploitables.

Cette étude de cas explore en profondeur un projet réel dans le cadre duquel des images de drones annotées ont été utilisées pour améliorer la surveillance et la gestion des cultures de maïs dans plusieurs fermes du Midwest.

Aperçu du projet : The Quest for Field-Level Precision 📍

L'initiative a débuté avec un objectif simple mais ambitieux : utiliser l'imagerie aérienne acquise par drone pour détecter les signes de stress des cultures à un stade précoce et à grande Scale AI. Nos partenaires, un réseau d'agronomes, d'agriculteurs et une équipe de data science, souhaitaient réduire la consommation inutile de pesticides et d'eau, tout en maximisant le rendement du maïs.

Pour y parvenir, nous avons dû :

- Capturez images multispectrales prises par drone au cours des principales étapes de croissance

- Données d'image d'étiquette avec des classes pertinentes sur le plan agronomique (par exemple, « surface foliaire chlorotique », « canopée saine », « sol nu »)

- Entraînez les modèles d'IA à analyser et prévoir les tendances en matière de santé des cultures

- Fournissez des résultats via un tableau de bord pour des informations exploitables au niveau de la parcelle

Ce pipeline exigeait non seulement des compétences techniques, mais aussi des connaissances spécifiques à un domaine, alliant vision par ordinateur, étiquetage des données et phytopathologie.

Stratégie de collecte de données : voler plus intelligemment, pas seulement plus 🛩️

L'un des éléments les plus négligés des pipelines d'IA basés sur les drones n'est pas combien les données que vous collectez, mais avec quelle intelligence vous le collectez. Les premiers déploiements de drones agricoles reposaient souvent par défaut sur des stratégies de « force brute », qui consistaient à couvrir autant d'hectares que possible, aussi souvent que possible. Mais nous avons vite appris que planification de vol plus intelligente peut permettre d'améliorer les performances des modèles, de réduire les coûts de stockage et de faire des prévisions plus pertinentes.

Voici comment nous avons abordé le déploiement de drones intelligents dans le cadre de ce projet d'annotation sanitaire du maïs :

Phases de croissance prioritaires

Au lieu de vols régulièrement espacés, notre horaire était pondéré autour de stades critiques de croissance du maïs: V4—V6 (végétatif), VT—R1 (épandage et soie) et R3—R5 (développement du grain). Ces fenêtres sont quand pics d'absorption des nutriments, des maladies apparaissent et le stress de la canopée devient visible.

🧠 Aperçu : Les vols effectués au cours de ces étapes biologiquement significatives ont donné lieu à des annotations avec valeur en aval supérieure, notamment pour détecter les tensions à un stade précoce et prévoir les rendements.

Échantillonnage stratifié dans tous les microclimats

Les champs n'étaient pas traités comme des surfaces uniformes. Nous avons utilisé données satellitaires et cartes de rendement historiques pour diviser chaque champ en microzones. Certaines zones étaient plus sujettes à la rétention d'eau, d'autres à la perte de nutriments ou à des épidémies fongiques. Des drones ont été chargés de voler à une fréquence plus élevée dans ces zones à haut risque, en collectant davantage de données là où la variabilité était la plus importante.

Optimisation de la charge utile multicapteur

Chaque drone transportait à la fois Caméras RGB et multispectrales (y compris Red Edge et NIR), ce qui a permis le post-traitement dans :

- NDVI (indice de végétation par différence normalisée) pour la teneur en chlorophylle

- NDRE (NDVI à bord rouge) pour le statut azoté

- Cartes de température du couvert végétal via des revêtements thermiques

- Modèles 3D de hauteur de canopée à partir de cadres superposés

La combinaison de ces flux de données a permis aux équipes d'annotation d'identifier des modèles de contrainte subtils qui ne seraient pas détectés par une approche à capteur unique. Par exemple, une zone chlorotique avec une hauteur de canopée inchangée peut indiquer une carence en azote plutôt qu'un retard de croissance.

Trajectoires de vol efficaces grâce au prétraitement par IA

Pour réduire la consommation d'énergie et le temps de vol, nous avons utilisé Optimisation de la trajectoire de vol grâce à l'IA. Au lieu de tracer des quadrillages, les drones ont volé trajectoires basées sur des priorités et à altitude variable, en se concentrant d'abord sur les zones signalées par un faible NDVI ou des problèmes de ravageurs historiques. Cela a rendu chaque vol plus efficace et a maximisé le retour sur investissement de la collecte de données aéroportées.

Chronométrage et étalonnage de la lumière

Les images des drones peuvent être fortement affectées par angle du soleil, couverture nuageuse et même vent. Nous avons intégré intégrations d'API météorologiques en temps réel pour retarder ou faire avancer automatiquement les missions en fonction de la clarté prévue, en veillant à ce que les images aient été capturées dans des conditions optimales.

En intégrant ces techniques de vol intelligentes, le projet a généré des ensembles de données haute fidélité avec un minimum de bruit et un potentiel d'apprentissage maximal. Le résultat ? De meilleures annotations, une segmentation plus cohérente et Des modèles d'IA performants dans des conditions de terrain inédites.

🔗 Vous souhaitez savoir comment la télédétection influe sur la prévision des rendements ? Voir cet article de Agronomie.

Création d'un schéma d'étiquetage robuste pour Plant Health 🌾

L'annotation ne se limitait pas à dessiner des cases, elle impliquait la conception d'un taxonomie agricole personnalisée fondé sur la phytologie. En collaboration avec des agronomes, nous avons défini un schéma d'étiquetage qui comprenait :

- Canopée de maïs saine

- Chlorose/Zones vert pâle

- Tissu nécrotique

- Présence de mauvaises herbes

- Zones gorgées d'eau

- Sol nu

- Dommages mécaniques

Chaque image a été divisée en tuiles superposées, puis annotée à l'aide d'une segmentation polygonale pour préserver la précision spatiale. Il est important de noter que chaque étiquette était mappé à un indicateur agronomique, en veillant à ce que le modèle final d'IA puisse prendre des décisions fondées sur la pertinence biologique.

🔗 Pour en savoir plus sur la classification des images agronomiques, voir cette revue sur la télédétection pour le phénotypage des cultures.

Défis liés à la variation saisonnière et à l'étiquetage temporel 🌤️

L'un des principaux obstacles à l'annotation agricole est changement de saison. Les plants de maïs présentent un aspect radicalement différent au stade V6 (stade à six feuilles) par rapport à R1 (stade soyeux). Ainsi, l'étiquetage devait être conscient de la scène. Par exemple :

- Le jaunissement à un stade précoce peut indiquer une carence en azote

- Le jaunissement à l'approche de la récolte peut être tout à fait normal (sénescence)

Pour gérer cela, les annotateurs ont été formés pour calendriers phénologiques de référence et fonctionnent parallèlement à des rapports sur les récoltes horodatés. Nous avons également intégré des métadonnées temporelles (stade de croissance, précipitations récentes, application d'engrais) dans chaque lot d'images afin de contextualiser les annotations.

Cela a permis à l'ensemble de données non seulement spatialement précis, mais aussi pertinent dans le temps—un outil indispensable pour la modélisation prédictive.

Entraîner l'IA : transformer les pixels étiquetés en informations agricoles 🧠🌽

Une fois annotées, les images alimentaient un modèle de segmentation sémantique basé sur une architecture U-Net. Ce modèle a été chargé de classer chaque pixel d'une image de drone dans l'une des classes agronomiques.

Pour améliorer la généralisation des conditions d'éclairage et de terrain, l'équipe a :

- Appliqué augmentation des données (par exemple, changements de contraste, flou, recadrage inversé)

- Usagé fusion multispectrale, combinant les couches RGB et NDVI

- Entraîné pendant plusieurs saisons pour améliorer la robustesse

Les paramètres d'évaluation comprenaient :

- IoU (Intersection au-dessus de l'Union) par classe

- Score de F1 pour les principaux indicateurs de stress

- Précision au niveau du terrain pour la prévision de l'état de santé de

Les performances du modèle étaient particulièrement bonnes en matière de détection chlorose et nécrose au début du cycle de croissance, ce qui a aidé les agronomes à recommander des mesures correctives avant une perte de rendement irréversible.

Des résultats concrets : économiser les intrants, augmenter le rendement 📈

Grâce à une annotation précise à l'aide de drones, le projet a atteint les objectifs suivants :

- Réduction de 21 % de l'utilisation d'engrais azotés sur des parcelles surveillées

- Augmentation du rendement de 14 % par rapport aux champs de contrôle non surveillés

- Détection précoce de épidémies fongiques 2 semaines avant l'apparition des symptômes

- L'application ciblée de pesticides a permis de réduire l'utilisation de produits chimiques en 17 %

Ces résultats n'étaient pas seulement académiques : ils ont permis de réaliser des économies de coûts tangibles et d'apporter des avantages environnementaux. Les agriculteurs ont apprécié de pouvoir agir plus tôt, appliquer moins, et récolter plus.

Un résumé détaillé de l'impact est disponible sur Alliance PrecisionAG.

Leçons apprises sur le terrain 🧪

La collaboration interdisciplinaire est essentielle

Ce projet a réussi non seulement grâce à la technologie, mais parce que agronomes, data scientists et opérateurs de drones a travaillé en équipe. Chaque étiquette mal alignée ou image ambiguë a été traitée comme une chance d'améliorer à la fois l'ensemble de données et le modèle.

L'annotation nécessite un contexte agronomique

La vision par ordinateur à elle seule ne permet pas de savoir que le jaunissement de fin de saison peut être normal. Incorporant métadonnées relatives au stade de croissance et calendriers saisonniers dans les décisions d'annotation, les données d'entraînement étaient beaucoup plus précises.

Davantage de données n'est pas toujours une meilleure solution

Au début du projet, nous avons visé le volume. Mais il est devenu évident que annotations cohérentes et de haute qualité battez des ensembles de données volumineux avec des erreurs d'étiquetage. Nos modèles les plus performants ont été formés sur 30 % d'images en moins, mais avec des libellés contextuels plus cohérents.

Ce que cela signifie pour l'avenir de l'IA agricole 🌍

Le succès de cette étude de cas représente bien plus qu'une innovation ponctuelle, c'est une plan directeur pour l'avenir de l'agriculture alimentée par l'IA. Alors que les défis liés au stress climatique, à la croissance démographique et à la sécurité alimentaire convergent, les solutions évolutives telles que l'annotation par drone et les flux de travail intelligents d'IA deviendront essentielles à la mission.

Voici comment cela façonne l'avenir :

Du réactif au prédictif, puis au prescriptif

Aujourd'hui, la plupart des exploitations agricoles fonctionnent toujours de manière réactive, réagissant aux signes visuels de stress des cultures alors qu'il est peut-être déjà trop tard. Grâce aux données de drones annotées et à l'analyse de l'IA, nous pouvons évoluer à partir de :

- Réactif : Repérer les cultures qui jaunissent après des dommages

- Prédictif : Prévoir le stress 1 à 2 semaines à l'avance

- Prescriptif : Recommandation de mesures spécifiques sur la base d'une analyse au niveau de la zone (par exemple, appliquer 15 kg d'azote dans la section D4 uniquement)

Cette précision permet recommandations spécifiques au site, et non des traitements généraux, ce qui permet de réduire les coûts et de protéger l'environnement.

Drones autonomes + Edge AI

Les futurs déploiements tireront parti systèmes de drones autonomes équipé de puces Edge AI, permettant un traitement en temps réel directement en vol. Cela déverrouille :

- Alertes sur les maladies à la volée

- Triage des données en vol (par exemple, ignorer les zones saines)

- Des essaims de drones pour les grandes plantations

Combinées à la connectivité 5G ou LoRaWAN, les informations en temps réel peuvent être transmises directement aux agronomes ou aux tableaux de bord avant même que le drone n'atterrisse.

Expansion à d'autres cultures et facteurs de stress

Bien que cette étude de cas soit axée sur le maïs, la même méthodologie s'applique à :

- Blé: détection de la rouille et de la brûlure des feuilles

- Soja: fermeture de la canopée et surveillance de la nodulation

- Vignobles: stress hydrique et infestation de ravageurs

- Vergers: estimation de la taille des fruits et maladies au niveau des branches

Chaque culture présente de nouveaux défis en matière d'étiquetage et de taxonomies spécifiques à un domaine, mais les principes de les pipelines aériens d'IA annotés restent constants.

Intégration avec l'IoT, les données satellitaires et les données météorologiques

L'annotation n'est qu'une pièce du puzzle. L'avenir se trouve dans fusion multisources, où les images de drones, les flux satellites, les sondes de sol et les modèles météorologiques convergent vers un couche d'IA unifiée. Cette vision holistique permet de :

- Prévoir les besoins en irrigation

- Modéliser les modèles de migration des ravageurs

- Simuler le rendement selon différents scénarios de traitement

Cette intégration ouvre la voie à jumeaux numériques au niveau de la ferme, où chaque hectare est modélisé et optimisé en permanence.

Démocratiser l'IA pour les petits agriculteurs

La plupart des solutions Drone-AI sont encore concentrées dans les grandes fermes industrielles. La prochaine étape est accessibilité. Avec des drones moins chers, des modèles open source et des plateformes d'IA en tant que service, les petits agriculteurs peuvent accéder au même pouvoir prédictif. Cela est crucial dans des régions comme l'Afrique subsaharienne ou l'Asie du Sud-Est, où l'amélioration des rendements pourrait réduire considérablement l'insécurité alimentaire.

Construisons ensemble des domaines plus intelligents 🚀

Si vous travaillez dans le domaine de l'agrotechnologie, de la télédétection ou de l'IA agricole et que vous souhaitez découvrir comment l'imagerie annotée par drone peut transformer la gestion de vos cultures, connectons-nous. Chez DataVlab, nous avons aidé des équipes d'IA et des agronomes à créer des ensembles de données précis, évolutifs et scientifiquement fondés qui font réellement la différence sur le terrain.

👉 Êtes-vous prêt à améliorer votre IA agricole ? Prenez contact avec nos experts aujourd'hui.